一、本文介绍

本文给大家带来的改进是用 FocalModulation技术来替换了原有的SPPF (快速 空间金字塔池化 )模块。FocalModulation是今年新提出的特征增强方法,它利用注意力机制来聚焦于图像中的关键区域,从而提高模型对这些区域的识别能力。与SPPF相比,FocalModulation不仅能够处理不同尺寸的输入图像,还能更精确地识别和定位图像中的对象。 这一技术特别适用于处理那些难以检测的小对象或在复杂背景中的对象(更多的检测效果请看第二章) 。 我进行了简单的实验,这个FocalModulation能够提升一定的精度,其不影响任何的计算量和参数所以还是可以尝试的 (改进起来也比较简单)。

二、 FocalModulation模型 原理

论文地址: 官方论文地址

代码地址: 官方代码地址

2.1 SPP和 SPPF 回顾

在开始讲FocalModulation模块之前先简单回顾一下SPP和SPPF 。

SPPF(Spatial Pyramid Pooling Fast)是一种在 深度学习 和 计算机视觉 领域中使用的技术,特别是在目标检测任务中。它是空间金字塔池化(Spatial Pyramid Pooling,简称SPP)的一个变体或快速版本。下面是SPP和SPPF的基本概念:

-

空间金字塔池化(SPP) : SPP是一种网络层,用于解决 卷积神经网络 (CNN)中固定大小输入的限制。在标准CNN中,网络的输入图像需要被调整到固定的尺寸,这可能导致信息丢失或畸变。SPP通过对不同区域进行池化操作来允许网络处理任意大小的输入。这样,SPP层能够生成固定长度的输出,即使输入图像的尺寸不同。这对于图像分类和目标检测任务非常有用。

-

SPPF(快速空间金字塔池化) : SPPF是SPP的一个改进版本,旨在提高处理速度和效率。它通常在目标检测框架中用于提高模型在处理不同尺寸输入时的速度和精度。SPPF能够更快地进行区域池化操作,并且通常在现代的目标检测架构中,如YOLO(You Only Look Once)系列网络中被集成。

总结: SPPF就是允许网络处理各种尺寸的输入图像,然后它能够产生相同的输出大小的图像,同时保持较高的处理速度,这就是SPPF的作用。

2.2 FocalModulation模型的 基本原理

Focal Modulation Networks(FocalNets) 的基本原理是替换自注意力(Self-Attention)模块,使用 焦点调制(focal modulation)机制 来捕捉图像中的长距离依赖和上下文信息。下图是自注意力和焦点调制两种方法的对比。

自注意力要求对每个查询令牌(Query Token)与其他令牌进行复杂的查询-键(Query-Key)交互和查询-值(Query-Value)聚合,以计算注意力分数并捕捉上下文。而焦点调制则先将空间上下文以不同粒度聚合到调制器中,然后以查询依赖的方式将这些调制器注入到查询令牌中。 焦点调制简化了交互和聚合操作,使其更轻量级 。 在图中,自注意力部分使用红色虚线表示查询-键交互和黄色虚线表示查询-值聚合,而焦点调制部分则用蓝色表示调制器聚合和黄色表示查询-调制器交互。

FocalModulation模型通过以下步骤实现:

1. 焦点上下文化: 用深度卷积层堆叠来编码不同范围的视觉上下文。

2. 门控聚合:

通过门控机制,选择性地将上下文信息聚合到每个查询令牌的调制器中。

3. 逐元素仿射变换:

将聚合后的调制器通过仿射变换注入到每个查询令牌中。

下面来分别介绍这三个机制->

2.2.1 焦点上下文化

焦点上下文化(Focal Contextualization) 是焦点调制(Focal Modulation)的一个组成部分。焦点上下文化 使用一系列深度卷积层(depth-wise convolutional layers) 来编码不同范围内的视觉上下文信息。这些层可以捕捉从近处到远处的视觉特征,从而允许网络在不同层次上理解图像内容。通过这种方式,网络能够在聚合上下文信息时保持对局部细节的敏感性,并增强对全局结构的认识。

这张图详细比较了自注意力(Self-Attention, SA)和焦点调制(Focal Modulation)的机制,并 特别展示了焦点调制中的上下文聚合过程 。左侧的图展示了自注意力模型如何通过键(k)和查询(q)之间的交互,以及随后的聚合来生成输出。而中间和右侧的图说明了焦点调制如何通过层级化的上下文聚合和门控聚合过程替代自注意力模型的这一过程。在焦点调制中,输入首先通过轻量级线性层进行处理,然后通过层级化的上下文化模块和门控机制来选择性地聚合信息,最终通过调制器与查询(q)进行交互以生成输出。

2.2.2 门控聚合

在 Focal Modulation Networks(FocalNets) 中的 "门控聚合"(Gated Aggregation)是关键组件之一,这一过程涉及使用门控机制来选择性地聚合上下文信息。以下是这个过程的详细分析:

1. 什么是门控机制?

门控机制在深度学习中常用于控制信息流。它通常用于决定哪些信息应该被传递,哪些应该被阻断。在循环

神经网络

(RNN)中,特别是在长短期记忆网络(LSTM)和门控循环单元(GRU)中,门控机制用于调节信息在时间序列数据中的流动。

2. 门控聚合的目的

在FocalNets中,门控聚合的目的是为每个查询令牌(即处理中的数据单元)选择性地聚合上下文信息。这意味着网络能够决定哪些特定的上下文信息对于当前处理的查询令牌是重要的,从而专注于那些最相关的信息。

3. 如何实现门控聚合?

实现门控聚合可能涉及一系列计算步骤,其中包括:

- 计算上下文信息:这可能涉及使用深度卷积层(如文中提到的)对输入图像的不同区域进行编码,以捕捉从局部到全局的视觉上下文。

- 门控操作:这一步骤涉及到一个决策过程,根据当前查询令牌的特征来决定哪些上下文信息是相关的。这可能通过一个学习到的权重(门)来实现,该权重决定了不同上下文信息的重要性。

- 信息聚合:最后,根据门控操作的结果,选择性地聚合上下文信息到一个调制器中。这个调制器随后被用于调整或“调制”查询令牌的表示。

4. 门控聚合的好处

通过门控聚合,FocalNets能够更有效地聚焦于对当前任务最关键的信息。这种方法提高了模型的效率和

性能

,因为它减少了不必要信息的处理,同时增强了对关键特征的关注。在视觉任务中,这可能意味着更好的目标检测和图像分类性能,特别是在复杂或多变的视觉环境中。

总结: 门控聚合是FocalNets的一个核心组成部分,它通过选择性地集中处理重要的上下文信息来提升网络的效率和性能。

2.2.3 逐元素仿射变换

在Focal Modulation Networks(FocalNets)中的第三个关键组件是 逐元素仿射变换 ,这个步骤涉及将 通过门控聚合得到的调制器注入到每个查询令牌中 。以下是该过程的详细分析:

1. 仿射变换的基本概念:

仿射变换是一种线性变换,用于对数据进行缩放、旋转、平移和倾斜等操作。在深度学习中,逐元素的仿射变换通常指的是对每个元素进行线性变换,这种变换可以被描述为y = ax + b,其中x是输入,y是输出,a和b是变换的参数。

2. 逐元素仿射变换的作用:

在FocalNets中,逐元素仿射变换的作用是将聚合后的调制器信息注入到每个查询令牌中。这个步骤对于整合上下文信息和查询令牌的原始特征非常重要。通过这种方式,调制器所包含的上下文信息可以直接影响查询令牌的表示。

3. 执行仿射变换:

执行这一步骤时,聚合后的调制器对每个查询令牌进行逐元素的仿射变换。在实践中,这可能意味着对查询令牌的每个特征应用调制器中的相应权重(a)和偏差(b)。这样,调制器中的每个元素都直接对应于查询令牌的一个特征,通过调整这些特征来改变其表达。

4. 仿射变换的效果:

通过逐元素仿射变换,模型能够更细致地调整每个查询令牌的特征,根据上下文信息来增强或抑制某些特征。这种精细的调整机制允许网络更好地适应复杂的视觉场景,提高对细节的捕捉能力,从而提升了模型在各种视觉任务中的性能,如目标检测和图像分类。

总结: 逐元素仿射变换它使得模型能够利用上下文信息来有效地调整查询令牌,增强了模型对关键视觉特征的捕捉和表达能力。

三、FocalModulation的完整代码

下面是FocalModulation的完整代码,这个机制的使用方法我们看章节四, 需要注意得是该机制的修改方法需要按照有参数的注意力机制来修改!!!

- import torch.nn as nn

- from timm.models.layers import DropPath

- import torch

- __all__ = ['FocalModulation']

- class Mlp(nn.Module):

- """ Multilayer perceptron."""

- def __init__(self, in_features, hidden_features=None, out_features=None, act_layer=nn.GELU, drop=0.):

- super().__init__()

- out_features = out_features or in_features

- hidden_features = hidden_features or in_features

- self.fc1 = nn.Linear(in_features, hidden_features)

- self.act = act_layer()

- self.fc2 = nn.Linear(hidden_features, out_features)

- self.drop = nn.Dropout(drop)

- def forward(self, x):

- x = self.fc1(x)

- x = self.act(x)

- x = self.drop(x)

- x = self.fc2(x)

- x = self.drop(x)

- return x

- class FocalModulation(nn.Module):

- def __init__(self, dim, focal_window=3, focal_level=2, focal_factor=2, bias=True, proj_drop=0.,

- use_postln_in_modulation=False, normalize_modulator=False):

- super().__init__()

- self.dim = dim

- self.focal_window = focal_window

- self.focal_level = focal_level

- self.focal_factor = focal_factor

- self.use_postln_in_modulation = use_postln_in_modulation

- self.normalize_modulator = normalize_modulator

- self.f_linear = nn.Conv2d(dim, 2 * dim + (self.focal_level + 1), kernel_size=1, bias=bias)

- self.h = nn.Conv2d(dim, dim, kernel_size=1, stride=1, bias=bias)

- self.act = nn.GELU()

- self.proj = nn.Conv2d(dim, dim, kernel_size=1)

- self.proj_drop = nn.Dropout(proj_drop)

- self.focal_layers = nn.ModuleList()

- self.kernel_sizes = []

- for k in range(self.focal_level):

- kernel_size = self.focal_factor * k + self.focal_window

- self.focal_layers.append(

- nn.Sequential(

- nn.Conv2d(dim, dim, kernel_size=kernel_size, stride=1,

- groups=dim, padding=kernel_size // 2, bias=False),

- nn.GELU(),

- )

- )

- self.kernel_sizes.append(kernel_size)

- def forward(self, x):

- """

- Args:

- x: input features with shape of (B, H, W, C)

- """

- C = x.shape[1]

- # pre linear projection

- x = self.f_linear(x).contiguous()

- q, ctx, gates = torch.split(x, (C, C, self.focal_level + 1), 1)

- # context aggreation

- ctx_all = 0.0

- for l in range(self.focal_level):

- ctx = self.focal_layers[l](ctx)

- ctx_all = ctx_all + ctx * gates[:, l:l + 1]

- ctx_global = self.act(ctx.mean(2, keepdim=True).mean(3, keepdim=True))

- ctx_all = ctx_all + ctx_global * gates[:, self.focal_level:]

- # normalize context

- if self.normalize_modulator:

- ctx_all = ctx_all / (self.focal_level + 1)

- # focal modulation

- x_out = q * self.h(ctx_all)

- x_out = x_out.contiguous()

- if self.use_postln_in_modulation:

- x_out = self.ln(x_out)

- # post linear porjection

- x_out = self.proj(x_out)

- x_out = self.proj_drop(x_out)

- return x_out

- class FocalModulationBlock(nn.Module):

- """ Focal Modulation Block.

- Args:

- dim (int): Number of input channels.

- mlp_ratio (float): Ratio of mlp hidden dim to embedding dim.

- drop (float, optional): Dropout rate. Default: 0.0

- drop_path (float, optional): Stochastic depth rate. Default: 0.0

- act_layer (nn.Module, optional): Activation layer. Default: nn.GELU

- norm_layer (nn.Module, optional): Normalization layer. Default: nn.LayerNorm

- focal_level (int): number of focal levels

- focal_window (int): focal kernel size at level 1

- """

- def __init__(self, dim, mlp_ratio=4., drop=0., drop_path=0.,

- act_layer=nn.GELU, norm_layer=nn.LayerNorm,

- focal_level=2, focal_window=9, use_layerscale=False, layerscale_value=1e-4):

- super().__init__()

- self.dim = dim

- self.mlp_ratio = mlp_ratio

- self.focal_window = focal_window

- self.focal_level = focal_level

- self.use_layerscale = use_layerscale

- self.norm1 = norm_layer(dim)

- self.modulation = FocalModulation(

- dim, focal_window=self.focal_window, focal_level=self.focal_level, proj_drop=drop

- )

- self.drop_path = DropPath(drop_path) if drop_path > 0. else nn.Identity()

- self.norm2 = norm_layer(dim)

- mlp_hidden_dim = int(dim * mlp_ratio)

- self.mlp = Mlp(in_features=dim, hidden_features=mlp_hidden_dim, act_layer=act_layer, drop=drop)

- self.H = None

- self.W = None

- self.gamma_1 = 1.0

- self.gamma_2 = 1.0

- if self.use_layerscale:

- self.gamma_1 = nn.Parameter(layerscale_value * torch.ones((dim)), requires_grad=True)

- self.gamma_2 = nn.Parameter(layerscale_value * torch.ones((dim)), requires_grad=True)

- def forward(self, x):

- """ Forward function.

- Args:

- x: Input feature, tensor size (B, H*W, C).

- H, W: Spatial resolution of the input feature.

- """

- B, L, C = x.shape

- H, W = self.H, self.W

- assert L == H * W, "input feature has wrong size"

- shortcut = x

- x = self.norm1(x)

- x = x.view(B, H, W, C)

- # FM

- x = self.modulation(x).view(B, H * W, C)

- # FFN

- x = shortcut + self.drop_path(self.gamma_1 * x)

- x = x + self.drop_path(self.gamma_2 * self.mlp(self.norm2(x)))

- return x

四、手把手教你添加FocalModulation

4.1 修改一

第一还是建立文件,我们找到如下 ultralytics /nn文件夹下建立一个目录名字呢就是'Addmodules'文件夹 (用群内的文件的话已经有了无需新建) !然后在其内部建立一个新的py文件将核心代码复制粘贴进去即可。

4.2 修改二

第二步我们在该目录下创建一个新的py文件名字为'__init__.py'( 用群内的文件的话已经有了无需新建) ,然后在其内部导入我们的检测头如下图所示。

4.3 修改三

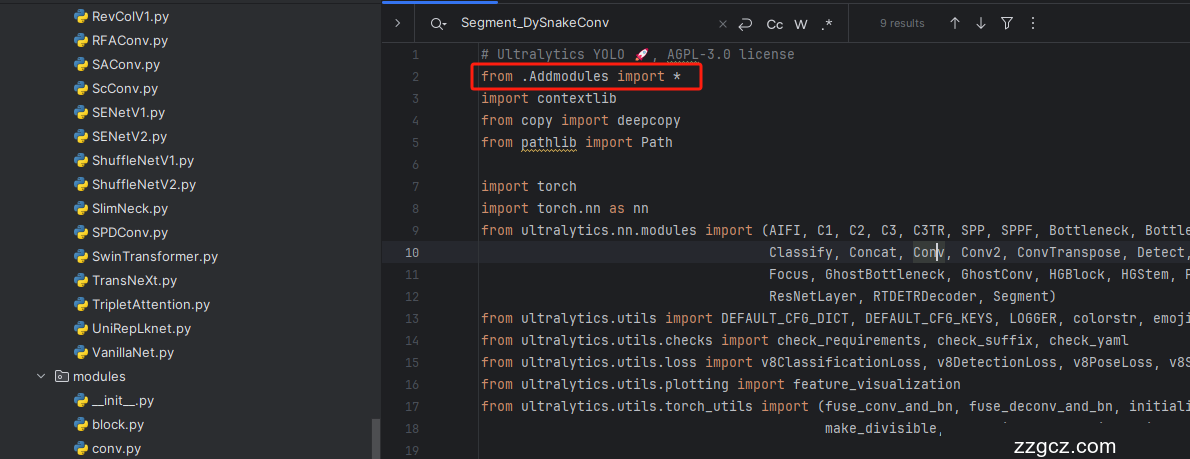

第三步我门中到如下文件'ultralytics/nn/tasks.py'进行导入和注册我们的模块( 用群内的文件的话已经有了无需重新导入直接开始第四步即可) !

从今天开始以后的教程就都统一成这个样子了,因为我默认大家用了我群内的文件来进行修改!!

4.4 修改四

按照我的添加在parse_model里添加即可。

到此就修改完成了,大家可以复制下面的yaml文件运行。

五、FocalModulation的yaml文件和运行记录

5.1 FocalModulation的yaml文件

此版本的信息:YOLO11-FocalModulation summary: 324 layers, 2,702,750 parameters, 2,702,734 gradients, 6.6 GFLOPs

- # Ultralytics YOLO 🚀, AGPL-3.0 license

- # YOLO11 object detection model with P3-P5 outputs. For Usage examples see https://docs.ultralytics.com/tasks/detect

- # Parameters

- nc: 80 # number of classes

- scales: # model compound scaling constants, i.e. 'model=yolo11n.yaml' will call yolo11.yaml with scale 'n'

- # [depth, width, max_channels]

- n: [0.50, 0.25, 1024] # summary: 319 layers, 2624080 parameters, 2624064 gradients, 6.6 GFLOPs

- s: [0.50, 0.50, 1024] # summary: 319 layers, 9458752 parameters, 9458736 gradients, 21.7 GFLOPs

- m: [0.50, 1.00, 512] # summary: 409 layers, 20114688 parameters, 20114672 gradients, 68.5 GFLOPs

- l: [1.00, 1.00, 512] # summary: 631 layers, 25372160 parameters, 25372144 gradients, 87.6 GFLOPs

- x: [1.00, 1.50, 512] # summary: 631 layers, 56966176 parameters, 56966160 gradients, 196.0 GFLOPs

- # YOLO11n backbone

- backbone:

- # [from, repeats, module, args]

- - [-1, 1, Conv, [64, 3, 2]] # 0-P1/2

- - [-1, 1, Conv, [128, 3, 2]] # 1-P2/4

- - [-1, 2, C3k2, [256, False, 0.25]]

- - [-1, 1, Conv, [256, 3, 2]] # 3-P3/8

- - [-1, 2, C3k2, [512, False, 0.25]]

- - [-1, 1, Conv, [512, 3, 2]] # 5-P4/16

- - [-1, 2, C3k2, [512, True]]

- - [-1, 1, Conv, [1024, 3, 2]] # 7-P5/32

- - [-1, 2, C3k2, [1024, True]]

- - [-1, 1, FocalModulation, []] # 9

- - [-1, 2, C2PSA, [1024]] # 10

- # YOLO11n head

- head:

- - [-1, 1, nn.Upsample, [None, 2, "nearest"]]

- - [[-1, 6], 1, Concat, [1]] # cat backbone P4

- - [-1, 2, C3k2, [512, False]] # 13

- - [-1, 1, nn.Upsample, [None, 2, "nearest"]]

- - [[-1, 4], 1, Concat, [1]] # cat backbone P3

- - [-1, 2, C3k2, [256, False]] # 16 (P3/8-small)

- - [-1, 1, Conv, [256, 3, 2]]

- - [[-1, 13], 1, Concat, [1]] # cat head P4

- - [-1, 2, C3k2, [512, False]] # 19 (P4/16-medium)

- - [-1, 1, Conv, [512, 3, 2]]

- - [[-1, 10], 1, Concat, [1]] # cat head P5

- - [-1, 2, C3k2, [1024, True]] # 22 (P5/32-large)

- - [[16, 19, 22], 1, Detect, [nc]] # Detect(P3, P4, P5)

5.2 训练代码

大家可以创建一个py文件将我给的代码复制粘贴进去,配置好自己的文件路径即可运行。

- import warnings

- warnings.filterwarnings('ignore')

- from ultralytics import YOLO

- if __name__ == '__main__':

- model = YOLO('yolov8-MLLA.yaml')

- # 如何切换模型版本, 上面的ymal文件可以改为 yolov8s.yaml就是使用的v8s,

- # 类似某个改进的yaml文件名称为yolov8-XXX.yaml那么如果想使用其它版本就把上面的名称改为yolov8l-XXX.yaml即可(改的是上面YOLO中间的名字不是配置文件的)!

- # model.load('yolov8n.pt') # 是否加载预训练权重,科研不建议大家加载否则很难提升精度

- model.train(data=r"C:\Users\Administrator\PycharmProjects\yolov5-master\yolov5-master\Construction Site Safety.v30-raw-images_latestversion.yolov8\data.yaml",

- # 如果大家任务是其它的'ultralytics/cfg/default.yaml'找到这里修改task可以改成detect, segment, classify, pose

- cache=False,

- imgsz=640,

- epochs=150,

- single_cls=False, # 是否是单类别检测

- batch=16,

- close_mosaic=0,

- workers=0,

- device='0',

- optimizer='SGD', # using SGD

- # resume='runs/train/exp21/weights/last.pt', # 如过想续训就设置last.pt的地址

- amp=True, # 如果出现训练损失为Nan可以关闭amp

- project='runs/train',

- name='exp',

- )

5.3 FocalModulation的训练过程截图

六、本文总结

到此本文的正式分享内容就结束了,在这里给大家推荐我的YOLOv11改进有效涨点专栏,本专栏目前为新开的平均质量分98分,后期我会根据各种最新的前沿顶会进行论文复现,也会对一些老的改进机制进行补充, 目前本专栏免费阅读(暂时,大家尽早关注不迷路~) ,如果大家觉得本文帮助到你了,订阅本专栏,关注后续更多的更新~